在电影《机械战警》中,用机器人充当警察、士兵的故事被设定在了 2028 年。电影里面的这些机器人,虽然不像漫威中的各种变种人一样拥有超能力,却也是同时具备人脑意识和机器人躯体的超级战士。

(图片来自:The Oracle)

尽管他们被部署为维护正义和和平的警察,但能否被所有人接受,以及会不会脱离人类的管控等,仍然是人们担忧的问题。

最后,影片中的美国总统否决了在本土部署机器人警察的议案。在现实中,这种担忧也不曾减少。

8 月 21 日,来自 26 个国家的 116 名人工智能领域专家共同向联合国发表了一封联名信,希望能禁止有关杀人机器人的研究和使用。

(图片来自:The Register)

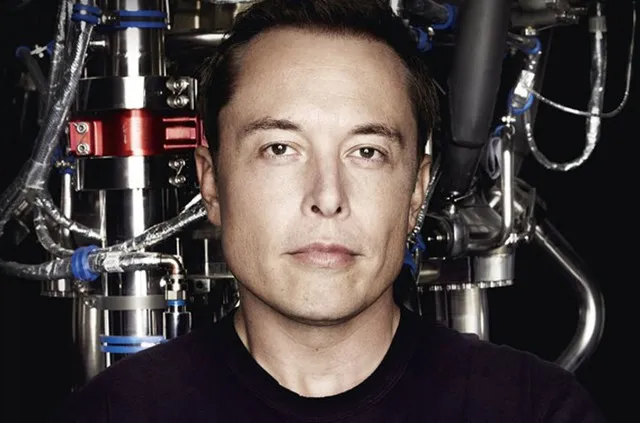

被人们称为“钢铁侠”的埃隆·马斯克,以及 Google 旗下 DeepMind 的联合创始人穆斯塔法·苏莱曼(Mustafa Suleyman),是这项倡议的主要发起人。虽然他们都是人工智能技术的支持和推动者,但他们认为,用机器人和人工智能技术武装的这种新型武器,可能会引发人类作战的“第三次革命”,还将会为人类带来比枪炮和核武器更大的威胁。

一旦被研发推广开来,这些致命性的自动化武器将有可能把战争规模扩大到一个前所未有的局面,战争发展的速度也会超出人们的想象。它们会成为恐怖袭击的利器,会被恐怖分子和独裁者用来对付无辜的平民,会被各种滥用。

这封联名信,是在今天于澳大利亚墨尔本召开的人工智能国际联合会议(IJCAI)上发布的,得到了该领域众多专家学者的支持。他们一致认为,这项行动“迫在眉睫”,因为联合国已经开始了有关这一议题的讨论和投票。只是本来要在今天进行的这场会议,最终被推迟到了 11 月份举行。

我们没有多少时间了。一旦潘多拉的魔盒被打开,就很难再被关上。

他们认为,联合国应该把这种杀人机器人列入被禁用的“杀伤性武器”之列,因为它们的威胁性,完全可以比肩生化武器、激光致盲武器等等,甚至还要更强。

(图片来自:Diplomatic Courier)

“人工智能将成为人类有史以来最大的生存威胁。”马斯克表示,他反复强调对人工智能进行立法规范的必要性。

与其他人工智能的应用场景不同的是,使用人工智能和机器人来制造自动化的武器系统,早已不是在科幻作品中才能看到的虚构画面。电影中在 2028 年才能出现的机械战警,也许在未来的十年内就能成为现实。

比如说如今很火的无人机,就被军队“征用”,打造成了新的杀伤性武器。如果你看过《战狼 2》,应该对里面无人机的战斗力印象深刻。

(图片来自:The Drone Girl)

还有语音识别、自动驾驶等技术,也早就被军事领域所吸纳。韩国曾经研发出了一种固定哨岗枪,可以自主实现追踪、语音识别并且开火;俄罗斯、美国等国家最近还制造出了一种可以实现自动驾驶、控制的坦克机器人。

(图片来自:Recode)

不过,新技术对军事装备、战争形式所带来的升级改造,总是会伴随着一些负面影响。比如说总是不差钱的恐怖组织,就常常会购买最尖端的高科技武器,造成生灵涂炭。

其实,这已经不是 IJCAI 第一次提出这样的倡议了。两年前,还是在这个会议上,马斯克和霍金就已经号召上千名人工智能领域的专家签署了一份同样的公开信,直接促使联合国开始把有关这项技术的讨论正式提上议程。

(图片来自:Communities Digital News)

在国际上,英国政府已经于 2015 年正式颁布了有关杀伤性自动化武器的禁令。其外交官员表示,在现行的国际人道主义法规中,已经对该领域做出了限制和规范。

新南威尔士大学的人工智能教授托比·沃尔士(Toby Walsh)认为,科技总是具有两面性。一方面,科技进步可以帮助我们解决很多现实社会中的难题,比如贫穷、气候变化、全球经济危机等;但另一方面,科技也可以被用来制造更新的武器,使战争也进一步工业化。

我们应该好好做出决定,哪一种未来才是我们真正想要的。

题图来自:The Next Web