相比识别图片,让人工智能系统识别视频内容,要困难的多。因为视频含有大量的信息,要机器理解视频中这些丰富的内容,一直是人工智能领域里未解决的问题。

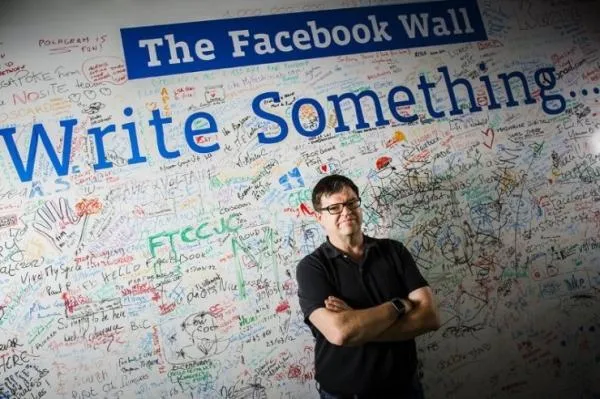

不过,在 Facebook 人工智能实验室负责人杨乐昆(Yann LeCun)看来,人类既然已经教会机器辨别图片,甚至能做到人脸识别,那么机器也能识别视频。而教会机器学习视频的方法与婴儿学习相似。即让机器像婴儿一样,观看视频,告诉它视频所讲的内容。

当地时间 3 月 9 日,《MIT 科技评论》发布了一篇关于 Facebook 人工智能实验室负责人杨乐昆(Yann LeCun)谈机器视觉技术的文章。在杨乐昆看来,现在机器视觉还有很多不足,只能理解人类教给它的知识,但这在未来会得到改变:通过训练,你给机器展示一段视频中的几帧画面,它就可以预测接下来会发生什么。

杨乐昆出生在法国,曾在多伦多大学跟随深度学习鼻祖 Geoffrey Hinton 进行博士后的研究,现在是纽约大学终身教授,是人工智能神经网络研究的先锋。在加盟 Facebook 之前,他在贝尔实验室工作了超过 20 年,那里是全世界最著名的计算机研究实验室,诞生过许多伟大的产品。杨乐昆在贝尔实验室工作期间开发了一套能够识别手写数字的系统,并把它命名为 LeNet。这个系统能自动识别银行支票。

以下是杨乐昆对人工智能机器视觉的理解:

目前机器视觉取得了哪些进展?

一张图里面有一个主体,规则是让机器给各类主体进行分类。只要你有足够的数据,类似每个目录有 1000 个主体,机器就可以对一些特定的类别产生认知,例如特定品牌的汽车,特定种类的植物或是特定品种的狗。我们还可以认识一些更为抽象的门类,例如天气图、地貌、日落、婚礼或生日聚会。仅仅 5 年前,我们还不太清楚机器是否已经完全解决了这个问题,但现在也不意味着机器视觉问题已经都解决了。

如今机器视觉还未 “解决”的重要问题是什么?

人们在几年前就有一种想法——为图片和视频生成一种标签或描述。从表面来看,现在已经有显著的进展了,但事实上这些成果没有他们看上去那么显著。机器在特定领域的知识仅限于我们教授给它们的内容。这些系统中的大部分会出现以下情况,你给它们看一些其他类别的图片,或给它们展示一些之前从未见过的场景,机器就会说出一堆垃圾。它们暂时还没有常识。

机器视觉和常识之间有什么样的联系?

这取决于你和谁讨论这个问题,即使是在 Facebook 内部也有不同的答案。你可以用语言与智能系统进行互动。但问题是语言是一种低带宽信息传输渠道。通过语言表达信息,是因为人类有许多背景知识能对这个信息进行理解。

有人认为,要向 AI 系统提供足够信息的唯一方法是将视觉感知作为基础,这要比语言作为输入带来的信息量高。如果你告诉机器“这是一个智能手机”;“这是一个压路机”;“这些东西是你能推动的,其他的不能搬动”,或许机器能像宝宝学习一样,掌握世界的一些基本知识。

因为婴儿无须受到具体的指引就可以从这个世界中学到很多东西。其中一件我们十分想做的事情就是,让机器通过观察视频或通过其他渠道来学习,向其展示真实世界中万物的联系。这种方法最终可以让机器掌握常识。这也是动物和婴儿在出生后前几个月学习的方式——你可以仅仅通过观察这个世界就从中学到相当多的东西。如今还有很多方式可以“愚弄”机器,因为它们对这个世界的认知非常有限。

“让机器从观察中学习”取得了什么进展?

有观点认为,机器学习系统应该可以预测未来,我们对这种想法十分感兴趣。你给机器展示一段视频中的几帧画面,它就可以预测接下来会发生什么。如果我们可以训练系统做到这点,我认为我们已经研发出了一种以无人监管学习系统为基础的技术。我认为,这就是更多有趣的事情很可能会发生的地方。这种应用在机器视觉并不是必要的,但确是人工智能领域取得的进步。